«Угадай, о чем я подумал»: нейросеть научилась распознавать образы из головы человека

Нейросеть Stable Diffusion смогла с высокой степенью точности воспроизвести изображения по фМРТ-снимкам головного мозга людей. На этих снимках видно лишь какие зоны мозга были активны, когда человек смотрел на ту или иную картинку. Сгенерированные картинки на 80% совпали с теми, которые были «задуманы». В большинстве случаев ИИ воссоздал даже цветовое решение оригинала.

Обучить искусственный интеллект видеть и распознавать окружающие объекты не хуже, чем это делает человеческий мозг — заветная мечта многих исследователей. Недавно мы рассказывали, как российские разработчики научили нейросеть анализировать рентгеновские снимки так, как их анализирует настоящий врач. А японские аспиранты из Осакского университета подошли к вопросу с другой стороны и научили нейросеть «читать мысли».

Суть эксперимента заключалась в том, чтобы по снимкам мозговой активности человека (фМРТ) программа понимала, какое именно изображение визуализировал человек в момент, когда был сделан снимок. Для обучения данному искусству выбрали нейросеть Stable Diffusion. Эта нейросеть с открытым кодом и доступна для внешнего обучения. В ее основе лежит диффузионная модель — ту же модель используют Midjourney, Imagen и другие модные нейросети, лидирующие в создании качественного визуального контента по текстовым описаниям.

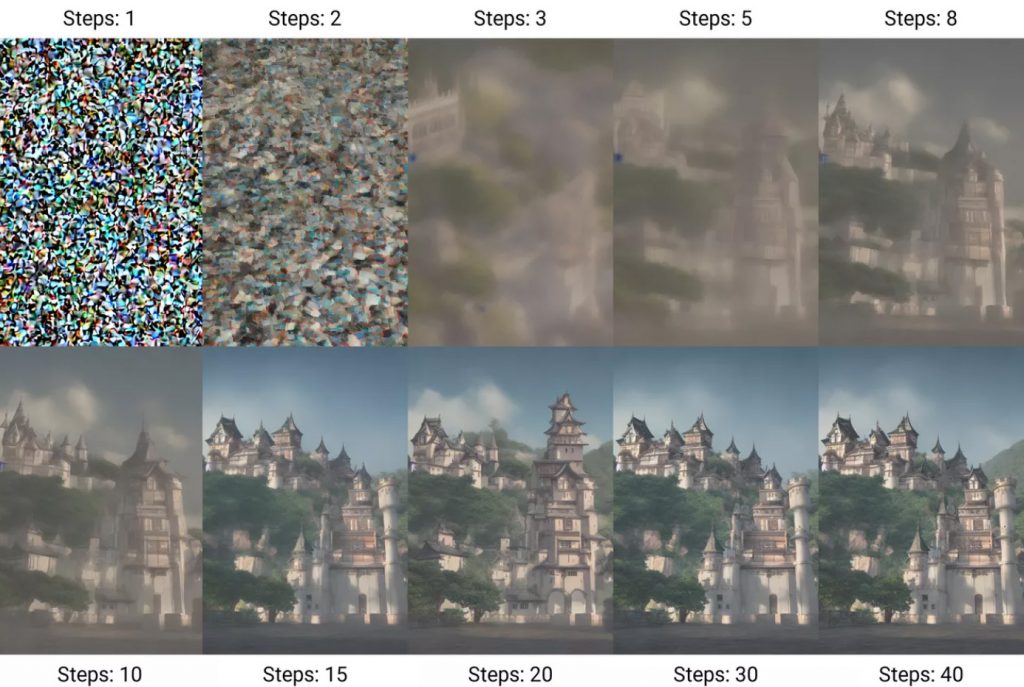

Многоэтапный процесс шумоподавления, используемый Stable Diffusion

Ранее диффузионные нейросети никогда не использовались для реконструкции изображений предметов на основе данных о мозговой активности людей. В отдельных работах для этой цели использовались другие типы нейросетей, но реконструируемые ими картинки обладали крайне низким качеством, при этом требовалось длительное и непростое обучение. Специалисты из Осаки предположили, что диффузионная модель позволит наконец-то создать реконструируемое изображение высокого качества, где «задуманный» предмет будет воспроизведен со всеми деталями.

В качестве обучающего материала для нейросети японцы воспользовались американской открытой базой Natural Scenes Dataset (NSD). Эту базу создавали специально для всех заинтересованных исследователей искусственного интеллекта. При ее создании 8 здоровых испытуемых тысячи раз рассматривали изображения реально существующих предметов, а в это время им делали фМРТ-сканирование головного мозга. Полученные сканы сопоставляли с изображениями. На сканах можно видеть, какие области мозга были наиболее активны при визуализации той или иной картинки.

Японские ученые взяли из базы NSD данные лишь четырех человек. Для обучения нейросети Stable Diffusion отобрали около 30 тысяч снимков фМРТ и соответствующих им изображений. Программу учили понимать по представленному снимку, какое изображение видел в этот момент испытуемый. При этом применялись простые линейные зависимости.

Также специалисты выделили две ключевых зоны мозга, отвечающих за визуализацию изображения. Оказалось, что височные доли отвечают за содержание, а затылочная зона воссоздает размер и общее расположение объектов. Для генерации «задуманных» объектов ученые соединили зрительную и семантическую информацию. По активности «визуальной» зоны коры нейросеть рисовала общий объем и перспективу. Затем подключалась семантическая информация, и диффузный алгоритм доводил картинку до узнаваемого объекта.

Для финального теста обученной нейросети использовали около тысячи ранее не задействованных в обучении фМРТ-снимков тех же испытуемых. Нейросеть справилась прекрасно: сгенерированные картинки на 80 процентов совпали с теми, на которые смотрел человек. В большинстве случаев ИИ даже воссоздал цветовое решение оригинала.

Конечно, до полноценного чтения мыслей пока еще далеко. Ученые уже успели убедиться, что качество реконструируемого объекта зависит от особенностей функционирования мозга конкретного испытуемого. Возможно, это связано со способностями того или иного человека к визуализации. Кроме того, нейросеть пока научилась распознавать только ограниченное количество изображений, заложенных при обучении. Тем не менее, достоинством работы является воспроизведение по фМРТ-сканам хорошо узнаваемых изображений. Важно также, что обучение оказалось сравнительно простым. С помощью той же технологии потенциально можно расшифровать субъективные переживания тестируемых и даже сны.